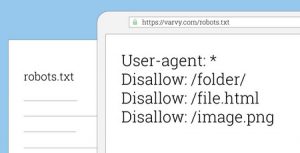

اسکریپت ایجاد فایل های robots

scriptsara

سلام! من علی هستم، بنیانگذار و مدیر سایت ScriptSara، جایی که دنیای کدنویسی، برنامهنویسی و آموزشهای تخصصی را با زبان ساده و قابل فهم به شما ارائه میدهد.

هدف ما در ScriptSara این است که پل ارتباطی میان دانش فنی و علاقهمندان به برنامهنویسی باشیم. از تازهکارها گرفته تا حرفهایها، همه میتوانند در اینجا آموزشهای کاربردی، پروژههای عملی و راهکارهای نوآورانهای پیدا کنند که مسیر یادگیریشان را هموارتر کند.

ما به روزترین تکنولوژیها، بهترین اسکریپتها و ابزارهای مورد نیاز توسعهدهندگان را معرفی میکنیم و با محتوای دقیق و قابل اعتماد، به شما کمک میکنیم تا تواناییهای خود را به سطحی بالاتر برسانید.

با ما همراه باشید تا هر روز قدمی به سوی آیندهای روشنتر در دنیای برنامهنویسی برداریم.